Ci ludzie nie istnieją! [wywiad]

Algorytmy nieustannie się doskonalą. Ich praca wciąż trwa. W tej chwili jest gdzieś jakiś algorytm, który cały czas się uczy. Z godziny na godzinę jest doskonalszy.

Rozmowa z red. Maciejem Gajkiem

Rozmowa z red. Maciejem Gajkiem

dziennikarzem magazynu „Newsweek”,

wydawcą serwisu online: Newsweek.pl

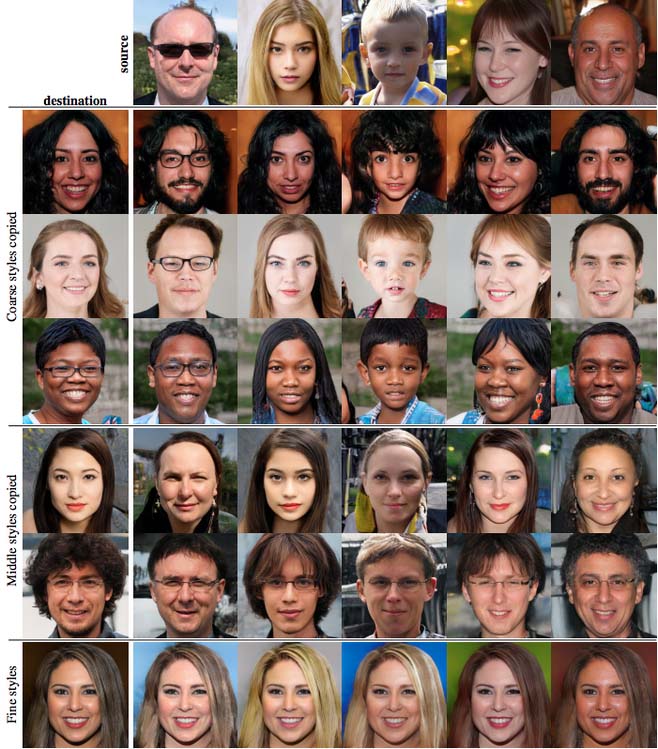

Patrzę na zdjęcie uśmiechniętych ludzi. Wyglądają tak realnie. Tak naturalnie. Tymczasem stoi za nimi algorytm…

Znaleźliśmy się w momencie, w którym coraz mniej powinniśmy wierzyć temu, co widzimy. Dotąd było tak, że jeśli coś było nagrane, było filmem, a nie była to hollywoodzka produkcja, tylko na przykład nagranie z kamery, czy telefonu – uznawaliśmy to za dowód. Podobnie było ze zdjęciem, uznawaliśmy je za dowód. Dziś coraz częściej jest tak, że nie możemy tego uznawać za dowód.

A za progiem czeka rzeczywistość, w której każdy element audiowizualny będziemy musieli sprawdzać i upewniać się, czy aby nie został stworzony przez jakiś algorytm.

Dziś mamy już takie narzędzia, aby przerabiać zdjęcia ludzi i stwarzać całkowicie nowe twarze. Obecnie potrzebujemy do tego bardzo uzdolnionego grafika. Trzeba mu zapłacić za pracę, a on musi nad tym zadaniem spędzić kilka, czy kilkanaście godzin. W to miejsce może natomiast wejść algorytm, który dzięki uczeniu maszynowemu, dzięki możliwościom, jakie dają algorytmy generatywne – może z łatwością zastąpić takiego grafika. I to co zdolny grafik, na drogim komputerze, z drogim oprogramowaniem robi przez kilkanaście godzin – taki algorytm stworzy w kilka minut i to w kilku różnych opcjach…

Zdjęcie, o którym Pani mówi stworzył algorytm, czyli sztuczna inteligencja. Ci ludzie ze zdjęcia naprawdę nie istnieją.

Fascynujące i przerażające jednocześnie.

To prawda. A to tylko zdjęcia. Mamy również do dyspozycji technologię deepfake – czyli możliwość manipulowania nagraniami wideo. Nie jest dziś żadnym kłopotem, aby wykorzystać jakieś nagranie wypowiedzi Władimira Putina i nałożyć na nie mimikę innej osoby, która będzie mówiła rzeczy, których Władimir Putin nigdy by nie powiedział.

Póki co te przykłady fałszowania nagrań – które się pojawiają na sieci – dają się jeszcze odróżnić od rzeczywistych. Pojawiają się na przykład pewne nierówności w skórze twarzy, pojawia się efekt blur wokół ust. Ale to tylko kwestia czasu.

Algorytmy poprawią swoją dokładność. One się nieustannie doskonalą. Ich praca wciąż trwa. W tej chwili jest gdzieś jakiś algorytm, który cały czas się uczy. Z godziny na godzinę jest doskonalszy.

Niebawem obudzimy się w rzeczywistości, w której nie będziemy w stanie ufać temu co widzimy na nagraniach. Będzie bowiem prawdopodobne, że to nagranie jest stworzone w całości, od A do Z, w komputerze.

Chińska telewizja zaprezentowała już światu takiego sztucznego prezentera.

Rządowa agencja prasowa Xinhua zaczęła wykorzystywać tego prezentera stworzonego dzięki sztucznej inteligencji do prowadzenia kanału na YouTubie.

Chińczycy poszli trochę na skróty, wykorzystali do tego eksperymentu prawdziwego dziennikarza. Zarejestrowali jego postać, mimikę – stworzyli model 3D. Przeanalizowali jego głos i potem zbudowali taki model. Model wzorowany na prawdziwym człowieku. Rodzaj awatara. Natomiast nic nie stoi na przeszkodzie, aby taki awatar powstał od początku do końca. Aby stworzyć takiego Jana Kowalskiego, czy Johna Smith’a, który będzie prowadził wiadomości.

Prezenter, który nie istnieje w rzeczywistości, a istnieje wyłącznie w pamięci komputera.

Zastanawiam się, kto będzie wtedy odpowiadał za treść informacji? Za ich wiarygodność, za ich zgodność z prawdą?

To jest bardzo poważne pytanie. Za zgodność z prawdą, za to co się mówi ludziom – nadal odpowiada nadawca wiadomości. Musimy pamiętać, że nadawcą nie jest algorytm. Nadawcą jest twórca tego algorytmu, czyli ten człowiek, lub organizacja, którzy posługują się tym algorytmem. I to ten człowiek decyduje o tym: co powiedzieć, jak to zrobić, jak coś pokazać, w jaki sposób przedstawiać określone wydarzenia. Algorytm jest tylko przekaźnikiem. To jest kolejne medium, kolejny rodzaj medium. Natomiast twórcą jest nadal człowiek. Musimy o tym pamiętać.

Czy realny dziennikarz w przyszłości nie będzie potrzebny?

Póki co to my, dziennikarze jesteśmy twórcami wiadomości. W przyszłości być może dziennikarze zamienią się w operatorów awatara. Będą operatorami medialnego algorytmu. I w ten sposób będą przekazywać innym wiadomości.

Dzisiaj dysponujemy sztuczną inteligencją rozszerzoną, czyli Augmented Intelligence, a nie Artificial Intelligence.

Czyli dysponujemy tym co, co poszerza nasze możliwości. Taki chiński awatar poszerza nasze możliwości. Możemy go zatrudnić na 24 godzinne dyżury w telewizji, bez odpoczynku, bez konieczności zapłaty za pracę. Co więcej – nie musimy mieć do dyspozycji studia telewizyjnego, kamer, oświetlenia, nie musimy zatrudniać operatorów, realizatorów, nie musimy mieć niczego poza komputerem. To komputer będzie generował obraz człowieka prezentującego wiadomości w studiu.

Czy to będzie dobre, czy raczej niebezpieczne?

Nie podejmuję się odpowiedzi na to pytanie. Będzie na pewno inaczej. Być może za pewien czas jakaś poważna telewizja zdecyduje się na takie rozwiązanie. I uruchomi kanał całkowicie stworzony w pamięci komputera. Zatrudni też takiego awatara, ale na serio. Nie jak w przypadku chińskiej telewizji, która zrobiła to w formie eksperymentu, jedynie po to, aby pochwalić się światu tą technologią.

Rzeczywiście już dziś mamy tę niezwykłą technologię do dyspozycji . Pytanie tylko, co dzięki niej będziemy pokazywać światu? Ten awatar musi o czymś mówić, musi przekazywać jakieś informacje. I to nadal muszą tworzyć ludzie.

Trzeba pamiętać, że dzisiejsze algorytmy są świetne w wykonywaniu bardzo konkretnych zadań. Na przykład: stworzenia awatara i przekazywania wiadomości za pomocą obrazu i dźwięku. Z tym sobie algorytm poradzi. Przeanalizuje spokojnie Big data, przeanalizuje o czym się pisze w Internecie.

Ale algorytm nie ma umiejętności rozumowania. Czyli nie jest w stanie zebrać tych informacji i wyciągnąć z nich rozsądnych wniosków.

Algorytm nie odpowie na pytanie: co jest ważne? To ja muszę na to odpowiedzieć. I ja muszę podjąć decyzję, co powiedzieć ludziom.

Jak radzić sobie w rzeczywistości, w której nie będziemy pewni, co jest prawdą, co fałszem?

Zawsze warto odwoływać się do zdrowego rozsądku , do własnego doświadczenia życiowego. Nas uczono kiedyś, że jeśli coś jest wydrukowane – jest zapewne prawdą.

Słowo drukowane było święte. Dziennikarzy uczono tego na studiach: „Jeśli masz coś drukowanego – możesz się na to powoływać. Zapewne jest to prawda”.

A dziś okazuje się, że te stare zasady nie muszą działać. Świat się zmienia.

I całkiem na serio ostrzegam przed tym, co – poza korzyściami – może przynieść sztuczna inteligencja.